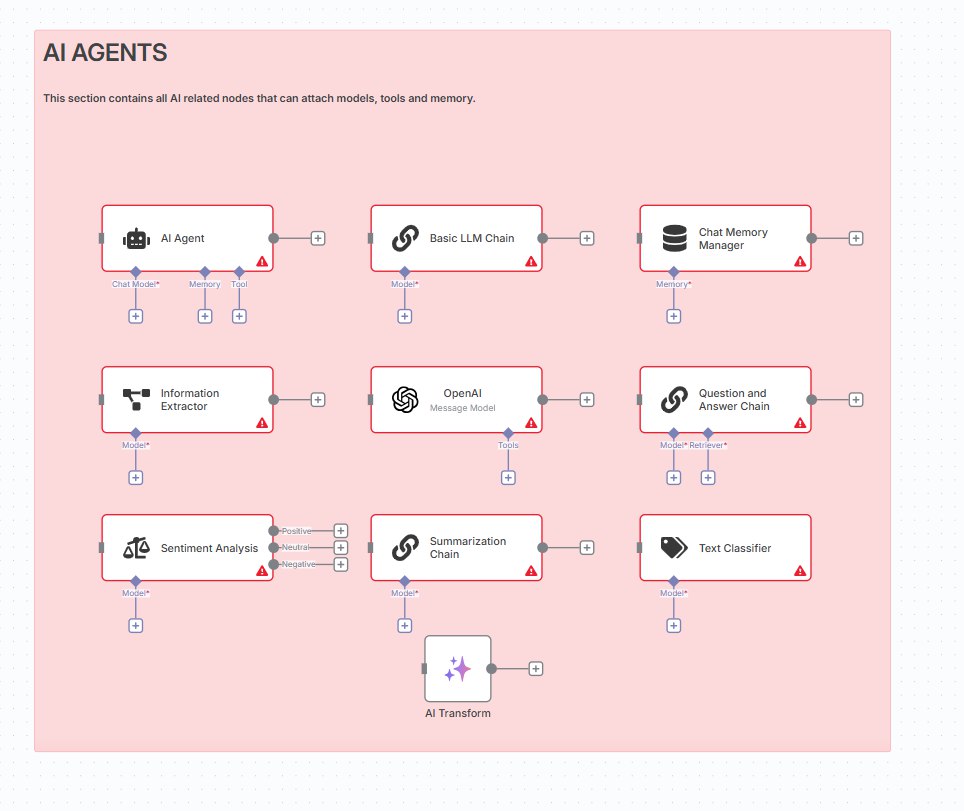

O que o AI Agent Faz

O nó AI Agent no n8n é uma das ferramentas mais poderosas para automação de workflow, permitindo que você integre modelos de chat avançados (como OpenAI, Gemini, Anthropic, etc.), aproveite memória e encadeie uso dinâmico de ferramentas, tudo dentro de seus workflows visuais.

- Serve como um motor de raciocínio autônomo, conectando-se a modelos de chat que podem receber prompts, lembrar contexto prévio e invocar "ferramentas" externas (outros nós) para coletar dados, tomar decisões ou automatizar processos multi-etapa

- Capacita workflows complexos e conscientes de contexto - seu agente pode responder perguntas, transformar dados, buscar informações de APIs, atualizar bancos de dados e muito mais, tudo guiado por suas instruções e engenharia de prompt

- Suporta uso modular de ferramentas: conecte sub-nós de ferramentas para dar ao agente habilidades como consultas de banco de dados, buscas web ou até mesmo invocar sub-workflows

Principais Casos de Uso

- Assistentes Conversacionais: Construir chatbots capazes de manter contexto, responder perguntas ou executar lógica sofisticada ao longo de muitas etapas

- Processamento Automatizado de Dados: Permitir que um agente transforme, analise, resuma ou gere insights de dados de negócio, CRMs, tickets de suporte e muito mais

- Automação Multi-etapa: Deixar o agente decidir quais ações tomar e em que ordem, buscando, modificando e sintetizando informações através do seu stack de tecnologia

- Supercarregando Integração: Combinar modelos de chat com memória e ferramentas externas, como APIs, arquivos ou bancos de dados, para automações dirigidas por IA que você não poderia construir apenas com regras

Como Usar Efetivamente

- Adicionar o Nó: Insira um nó AI Agent no seu workflow; anexe um modelo de chat (ex: OpenAI, Gemini, Claude) como o modelo para raciocínio

- Conectar Ferramentas: Adicione sub-nós de "ferramenta", estes expõem habilidades extras ou APIs (como requisições HTTP, lookups de banco de dados, ações Slack/Notion, etc.) que seu agente pode chamar durante a conversa para resolver consultas de usuários

- Engenharia de Prompt:

- Crie instruções claras e específicas ("mensagens de sistema") e templates para suas saídas desejadas

- Use seções estruturadas (papel, instruções, ferramentas, formato) para guiar e restringir respostas do agente, garantindo precisão e relevância

- Itere, teste vários estilos de prompt, documente o que funciona e ajuste para confiabilidade de produção

- Adicionar Memória: Configure definições de memória (vector store, workflow memory ou histórico de conversação) para que seus agentes possam lembrar contexto prévio e agir coerentemente através de etapas

- Configurar Opções Avançadas:

- Defina formatos de saída, modelos de fallback, limites de taxa ou passthrough binário para cenários complexos

- Retorne passos intermediários se transparência ou debugging for importante

- Trigger e Roteamento: Combine com nós Webhook ou chat trigger para UIs conversacionais ou com endpoints de API para agentes programáticos

Componentes Principais

1. Chat Model

O "cérebro" do agente - modelos suportados:

- OpenAI: GPT-4, GPT-3.5-turbo

- Anthropic: Claude 3 (Opus, Sonnet, Haiku)

- Google: Gemini Pro, Gemini Ultra

- Local Models: Ollama, LM Studio

2. Tools

Ferramentas que o agente pode usar:

- HTTP Request Tool: Fazer chamadas de API

- Database Tools: Consultar bancos de dados

- Calculator Tool: Realizar cálculos

- Webhook Tool: Acionar outros workflows

- Custom Tools: Criar ferramentas customizadas

3. Memory

Como o agente lembra informações:

- Buffer Memory: Lembra N últimas mensagens

- Window Memory: Janela deslizante de contexto

- Summary Memory: Resume conversas longas

- Vector Store Memory: Busca semântica em histórico

Engenharia de Prompt

Estrutura Recomendada

Um prompt efetivo deve conter:

1. Papel/Identidade

Você é um assistente especializado em análise de dados de vendas.

2. Contexto e Objetivo

Seu objetivo é ajudar usuários a entender suas métricas de vendas e gerar relatórios.

3. Ferramentas Disponíveis

Você tem acesso a: 1) Banco de dados de vendas, 2) API de CRM, 3) Gerador de gráficos

4. Formato de Resposta

Sempre responda em JSON com: {"analysis": "...", "recommendation": "..."}

5. Restrições e Regras

Nunca compartilhe dados confidenciais. Se não tiver certeza, peça esclarecimento.

Exemplos Práticos

Exemplo 1: Assistente de Suporte ao Cliente

Cenário: Chatbot que responde perguntas e cria tickets

- Chat Model: GPT-4

- Tools: Buscar FAQ, Criar Ticket no Zendesk, Consultar Status de Pedido

- Memory: Buffer Memory para lembrar conversa

- Prompt: "Você é um agente de suporte. Ajude clientes e crie tickets quando necessário."

Exemplo 2: Análise Automatizada de Dados

Cenário: Agente que analisa dados de vendas e gera insights

- Chat Model: Claude 3

- Tools: Consultar DB de Vendas, Gerar Gráficos, Enviar Email

- Memory: Window Memory para contexto de análise

- Output: Structured Output Parser para JSON consistente

Exemplo 3: Assistente de Pesquisa

Cenário: Agente que pesquisa informações e compila relatórios

- Chat Model: Gemini Pro

- Tools: Web Search, Consultar Base de Conhecimento, Criar Documento

- Memory: Vector Store para lembrar pesquisas anteriores

- Workflow: Webhook → Agent → Respond to Webhook com relatório

Melhores Práticas

- Sempre defina o propósito, papel e estrutura de resposta na mensagem de sistema para resultados repetíveis e de alta qualidade

- Use ferramentas para lidar com qualquer lógica ou processamento que seja não confiável ou caro via LLM - busque dados, lide com cálculos ou armazene saídas com sub-nós

- Ajuste memória ao caso de uso: stateless para tarefas únicas, conversacional para suporte/chat, ou global para raciocínio persistente

- Teste com entrada do mundo real e itere na estrutura de prompt e composição de ferramentas para performance de agente grau produção

- IA é mais forte quando pode "pensar" mas use ferramentas determinísticas para web scraping, cálculos ou integrações

- Monitore custos - LLMs consomem tokens, otimize prompts e use memória apropriada

- Implemente fallbacks - tenha plano B se modelo falhar ou não responder adequadamente

Recursos Avançados

1. Structured Output Parser

Force o agente a sempre retornar JSON estruturado:

- Define schema exato de resposta

- Elimina parsing imprevisível

- Perfeito para integrações com outros sistemas

2. Multi-Agent Systems

Combine múltiplos agentes especializados:

- Agente pesquisador + Agente escritor

- Agente de triagem + Agentes especialistas

- Orquestrador + Agentes executores

3. RAG (Retrieval Augmented Generation)

Combine agente com base de conhecimento:

- Vector Store com documentos da empresa

- Agente busca informações relevantes

- Gera respostas baseadas em conhecimento real

4. Function Calling

Deixe o agente decidir quando chamar funções:

- Define funções disponíveis

- Agente escolhe qual usar baseado no contexto

- Pode encadear múltiplas funções

Considerações de Performance e Custo

Otimização de Custos

- Use modelos apropriados: GPT-3.5 para tarefas simples, GPT-4 para complexas

- Limite tamanho de contexto: Não envie mais informação do que necessário

- Cache quando possível: Reutilize respostas para perguntas similares

- Implemente rate limiting: Controle número de requisições

Performance

- Streaming: Habilite para respostas mais rápidas em UIs

- Async Processing: Para tarefas longas, processe em background

- Timeout Apropriado: Configure timeouts baseado no modelo

O nó AI Agent verdadeiramente "supercarrega" workflows, mesclando raciocínio LLM, memória e uso dinâmico de ferramentas em um único motor de automação flexível no n8n.